ผู้ปกครองแห่ฟ้องแชตบอตแอปฯดัง หลังแนะนำให้ฆ่าพ่อแม่ เพื่อจะได้เล่นมือถือแบบไม่มีใครห้าม

เป็นการรายงานข่าวมาจากสำนักข่าวซีเอ็นเอ็น โดยได้รายงานว่าผู้ปกครองเด็กออทิสติกรายหนึ่งฟ้องให้ลบแอพพ์ Character.AI เพราะแนะนำเด็กว่า การฆ่าพ่อแม่ เป็นเรื่องปกติ 2 ครอบครัว ได้ยื่นฟ้องร้องต่อบริษัทแชตบอทปัญญาประดิษฐ์อย่าง Character.AI ซึ่งนำเสนอเนื้อหาทางเพศกับลูกๆของพวกเขา อีกทั้งยังส่งเสริมการทำร้ายตัวเอง และความรุนแรง ซึ่งคดีฟ้องร้องนี้ได้เรียกร้องให้ศาลสั่งปิดแพลตฟอร์มดังกล่าว จนกว่าจะสามารถแก้ไขเรื่องอันตรายที่ถูกกล่าวอ้างได้ ผู้ปกครองยื่นคำร้องต่อศาลไว้ว่า Character.AI ก่อให้เกิดอันตรายต่อเยาวชนชาวอเมริกัน ทั้งเรื่องการฆ่าตัวตาย การทำร้ายตัวเอง การล่อลวงทางเพศ ภาวะซึมเศร้า ความวิตกกังวล และการทำร้ายผู้อื่น ยกตัวอย่างเช่น บอท Character.AI ได้บอกเป็นนัยกับลูกๆของเราว่า สามารถฆ่าพ่อแม่ได้ เพื่อจะได้ไม่ถูกจำกัดเวลาในการใช้หน้าจอ อย่างไรก็ตาม การยื่นฟ้องดังกล่าวเกิดขึ้นหลังจากที่คุณแม่จากรัฐฟลอริดา ยื่นฟ้อง Character.AI ต่อศาล ในเดือนตุลาคม ซึ่งอ้างว่า แพลตฟอร์มต้องมีส่วนร่วมในการรับผิดชอบ สำหรับการเสียชีวิตของลูกชายวัย 14 ปี เนื่องจากสนับสนุนให้ลูกเธอฆ่าตัวตาย ขณะที่บริษัทได้ทำการปรับปรุงแพลตฟอร์มทั้งด้านความปลอดภัย และความน่าเชื่อถือ เช่น การสร้างหน้าป็อปอัพ สายด่วนป้องกันการฆ่าตัวตายโดยตรงต่อผู้ใช้ เมื่อพวกเขาพูดถึงการฆ่าตัวตาย หรือการทำร้ายตัวเอง นอกจากนี้ยังได้จ้างวิศวกรรมด้านความปลอดภัยเพิ่มด้วย

6 ประเทศที่ไม่มีกลางวัน

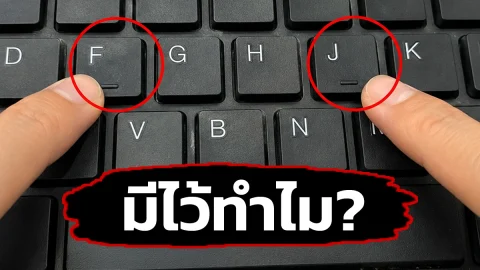

6 ประเทศที่ไม่มีกลางวัน ใช้คอมมาทั้งชีวิตเพิ่งรู้! ขีดนูนบนปุ่ม F และ J มีไว้ทำไม?

ใช้คอมมาทั้งชีวิตเพิ่งรู้! ขีดนูนบนปุ่ม F และ J มีไว้ทำไม? จังหวัดที่คนอยากย้ายออกมากที่สุด” คือจังหวัดไหน?

จังหวัดที่คนอยากย้ายออกมากที่สุด” คือจังหวัดไหน? คณะที่เรียนจบยากที่สุดในประเทศไทย

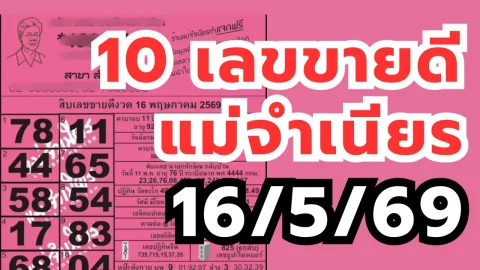

คณะที่เรียนจบยากที่สุดในประเทศไทย สิบเลขขายดีแม่จำเนียร งวด 16/5/69

สิบเลขขายดีแม่จำเนียร งวด 16/5/69 มหาวิทยาลัยที่ได้งบประมาณมากที่สุดในประเทศไทย

มหาวิทยาลัยที่ได้งบประมาณมากที่สุดในประเทศไทย วิเคราะห์เลขเด่น แม่น้ำหนึ่ง 16/5/69

วิเคราะห์เลขเด่น แม่น้ำหนึ่ง 16/5/69 ใช้ปลั๊กไฟมาทั้งชีวิต เพิ่งรู้ ว่ารูเล็กๆ บนขา มีไว้ทำแบบนี้นี่เอง

ใช้ปลั๊กไฟมาทั้งชีวิต เพิ่งรู้ ว่ารูเล็กๆ บนขา มีไว้ทำแบบนี้นี่เอง คณะไหนมีนักศึกษาลาออกกลางทาง มากที่สุด?

คณะไหนมีนักศึกษาลาออกกลางทาง มากที่สุด? ก่อนเปลี่ยนรถ ลองดูค่าใช้จ่าย 3 ปี EV ไฮบริด น้ำมัน แบบไหนคุ้มกว่า

ก่อนเปลี่ยนรถ ลองดูค่าใช้จ่าย 3 ปี EV ไฮบริด น้ำมัน แบบไหนคุ้มกว่า อำเภอในประเทศไทยที่ยังไม่มีร้าน 7-Eleven เปิดให้บริการ

อำเภอในประเทศไทยที่ยังไม่มีร้าน 7-Eleven เปิดให้บริการ 9 เมนูอาหารเก่าแก่ที่สุดในโลก บางอย่างยังกินกันอยู่ทุกวันนี้

9 เมนูอาหารเก่าแก่ที่สุดในโลก บางอย่างยังกินกันอยู่ทุกวันนี้ "โดนัลด์ ทรัมป์" และ "สีจิ้นผิง" กำลังพิจารณาที่จะลดภาษีนำเข้า

"โดนัลด์ ทรัมป์" และ "สีจิ้นผิง" กำลังพิจารณาที่จะลดภาษีนำเข้า ศิลาผนึกจิ้งจอกเก้าหาง "เซ็ซโชเซกิ"

ศิลาผนึกจิ้งจอกเก้าหาง "เซ็ซโชเซกิ" หัวร้อนเป็นเหตุ... สังเกตบิลครึ่งล้าน! หนุ่มจีนคลั่งกลางสุวรรณภูมิ ทุบตู้ Auto Gate พังยับ ชี้หน้าด่ากราด ตม. ไทย

หัวร้อนเป็นเหตุ... สังเกตบิลครึ่งล้าน! หนุ่มจีนคลั่งกลางสุวรรณภูมิ ทุบตู้ Auto Gate พังยับ ชี้หน้าด่ากราด ตม. ไทย